이미지 기반 검색 기술 '임베딩'…"韓 문화 이해도 탁월"

[서울=뉴스핌] 이성화 기자 = 카카오가 사람처럼 보고 듣고 말하며 한국어와 한국 문화를 가장 잘 이해하는 고도화된 멀티모달 인공지능(AI) 기술 연구 성과를 공개했다.

카카오는 12일 테크블로그를 통해 한국적 맥락 이해에 최적화된 통합 멀티모달 언어모델 '카나나-o(Kanana-o)'와 멀티모달 임베딩 모델 '카나나-v-임베딩(Kanana-v-embedding)'의 개발 과정과 성능을 공개했다.

'카나나-o'는 텍스트와 음성, 이미지를 동시에 이해하고 실시간으로 답변하는 통합 멀티모달 언어모델이다. 글로벌 모델 대비 한국어 맥락 이해에서 압도적 성능을 보유하고 있으며 사람처럼 자연스럽고 풍부한 표현력을 갖춘 것이 특징이다.

카카오는 기존 멀티모달 모델들이 텍스트 입력 시 강점을 보이지만 음성 대화에서는 답변이 단순해지고 추론 능력이 떨어지는 한계에 주목해 이를 보완했다. '카나나-o'의 지시 이행 능력을 고도화해 사용자의 숨은 의도와 복잡한 요구사항까지 파악할 수 있도록 개선했으며 자체 구축 데이터셋으로 학습해 다양한 모달리티 입출력에서도 기존 언어모델 성능을 유지하고 요약, 감정 및 의도 해석, 오류 수정, 형식 변환, 번역 등 다양한 과업을 수행할 수 있도록 성능을 끌어올렸다.

또한 고품질 음성 데이터와 직접 선호 최적화(DPO) 기술을 적용해 억양, 감정, 호흡 등을 정교하게 학습시켰다. 이를 통해 기쁨, 슬픔, 분노, 공포 등 상황별 생생한 감정 표현은 물론 미세한 음색과 어조 변화에 따른 감정 표현 능력도 향상됐다. 호스트와 게스트가 대화를 주고받는 팟캐스트 형태의 대화 데이터셋을 구축해 끊김 없이 자연스러운 멀티턴 대화도 가능해졌다.

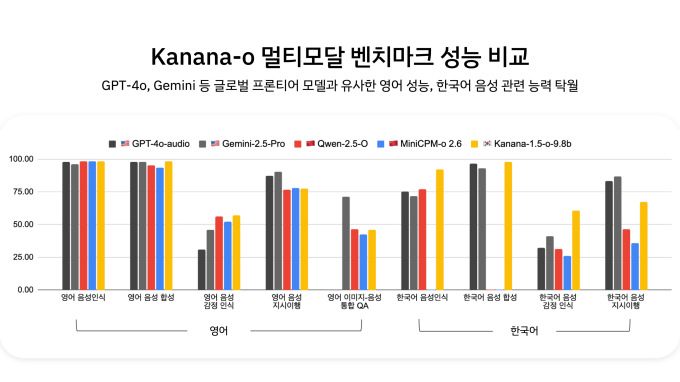

벤치마크 평가 결과 '카나나-o'는 영어 음성 성능에서 GPT-4o와 유사한 수준을 보였고 한국어 음성 인식 및 합성, 감정 인식 능력에서는 월등히 높은 수준을 기록했다. 카카오는 향후 더욱 자연스러운 동시 대화와 상황에 맞는 소리환경 실시간 생성이 가능한 진화된 모델로 발전시킬 계획이다.

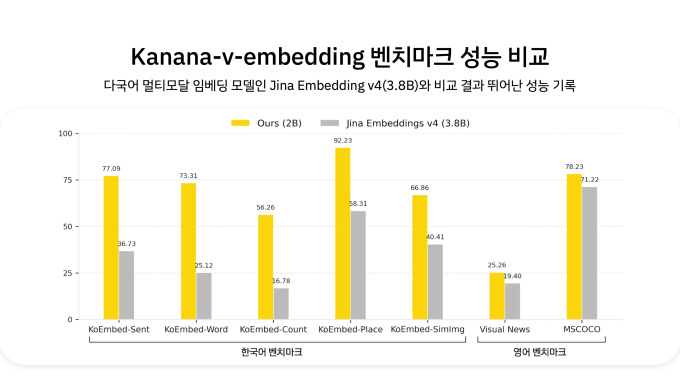

함께 공개된 '카나나-v-임베딩'은 이미지 기반 검색의 핵심 기술로 텍스트와 이미지를 동시에 이해해 처리할 수 있는 한국형 멀티모달 모델이다. 텍스트로 이미지를 검색하거나 사용자가 선택한 이미지와 관련된 정보를 찾고 이미지가 포함된 문서 검색도 지원한다.

특히 한국어와 한국 문화에 대한 이해도가 탁월해 '경복궁', '붕어빵' 같은 고유명사뿐만 아니라 '하멜튼 치즈'처럼 오타가 포함된 단어도 문맥을 파악해 정확한 이미지를 찾아준다. '한복 입고 찍은 단체 사진'처럼 복합 조건도 정확히 이해해 조건 일부에만 해당하는 사진을 걸러내는 높은 변별력을 갖췄다.

현재 '카나나-v-임베딩'은 카카오 내부에서 광고 소재 유사도 분석 및 심사 시스템에 적용 중이며 향후 비디오나 음성으로 범위를 확대해 다양한 서비스에 적용할 계획이다.

한편 카카오는 지난 5월 에이전틱 AI 구현을 위한 기능 강화에 중점을 둔 언어모델 '카나나-1.5'를 기반으로 모바일 기기 등 온 디바이스 환경에서 동작할 수 있는 멀티모달 모델의 경량화 연구를 진행하고 있다. 또한 전문가 혼합 구조인 MoE(Mixture of Experts)를 적용한 고성능·고효율 모델 '카나나-2' 개발도 준비하고 있다.

김병학 카카오 카나나 성과리더는 "카카오 자체 AI 모델 카나나는 단순 정보 나열을 넘어 사용자의 감정을 이해하며 친숙하고 자연스럽게 대화하는 AI가 될 수 있도록 한국적 맥락 이해와 표현력을 높여가고자 한다"며 "실제 서비스 환경을 통해 사용자들의 일상 속 AI 기술 경험을 만들어 나가고 사람처럼 상호작용할 수 있는 AI 구현에 주력할 것"이라고 말했다.

shl22@newspim.com