피해자들 감쪽같이 속아넘어가

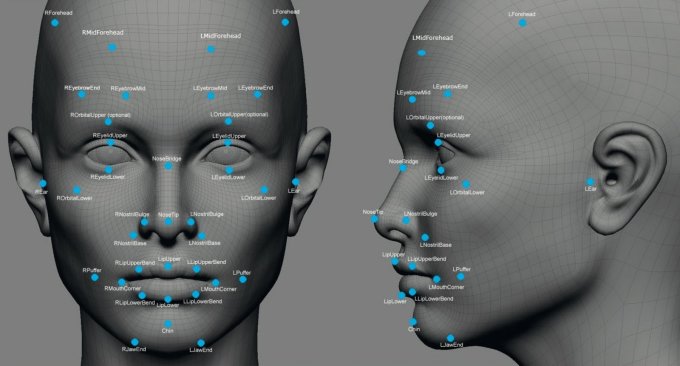

[베이징=뉴스핌] 조용성 특파원 = 중국에 AI 안면복제 음성복제 기술을 활용한 신종 사기사례가 속출하고 있다.

중국인터넷협회는 24일 홈페이지에 최근 잇달아 발생하고 있는 AI를 활용한 사기사례를 소개하며 소비자들에게 경각심을 당부했다고 중국 베이징청년보가 25일 전했다.

가장 최근 사건은 지난달 20일 발생했다. 당일 푸젠(福建)성의 사업가 A씨는 평소 본인과 가장 친한 사업가 친구로부터 위챗 영상통화를 받았다. 친구가 손을 흔들고 웃으며 인사를 했고 "놓칠 수 없는 좋은 경매물건이 나왔는데, 시간이 다급하니 430만위안(약 8억2000만원)을 송금해 달라"고 요청했다. 무한신뢰하는 친구였기에 A씨는 곧바로 송금을 했고, 송금후 친구에게 문자로 송금사실을 알렸다.

그러자 친구가 전화를 걸어와 황당해하며 '금시초문'이라고 말했고, A씨는 곧바로 경찰에 신고했다. 경찰은 즉시 해당계좌를 동결시켰다. 송금후 계좌동결까지 10분여 시간밖에 걸리지 않았지만, 계좌에서는 이미 94만위안이 빠져나간 후였다. A씨는 "화상통화로 친구와 정상적인 통화를 했으며, 전혀 이상한 낌새를 눈치채지 못했다"고 말했다. 현재 피해자금의 행방은 중국 경찰이 추적하고 있다.

올해 초 저장(浙江)성 원저우(溫州)시의 B씨는 친구로부터 위챗 영상전화를 받았다. 친구는 해외에서 중국으로 귀국하려는 과정에서 여행사가 신원보증금 입금을 요구한다며, B씨에게 대신 입금해줄 것을 요청했다. 영상통화를 통해 소통한 B씨는 별다른 의심없이 4만9000위안의 보증금을 입금했으나, 이는 사기였다. 범인은 B씨 친구의 SNS에 개제된 동영상을 이용해 안면복제와 음성복제를 했으며, SNS에서 B씨와 친하다는 사실을 알아냈고, 이를 활용해 B씨와 화상통화를 진행했다.

매체는 이와 함께 비슷한 방식으로 AI 안면복제와 음성복제를 활용해 성관계 동영상을 제작한 후 이를 유포시키겠다고 협박하며 금품편취를 시도하는 경우도 발생하고 있다고 전했다.

ys1744@newspim.com